提案手法

1. The inker's main purpose is to translate the penciller's graphite pencil lines into reproducible, black, ink lines.

2. The inker must honor the penciller's original intent while adjusting any obvious mistakes.

3. The inker determines the look of the finished art.

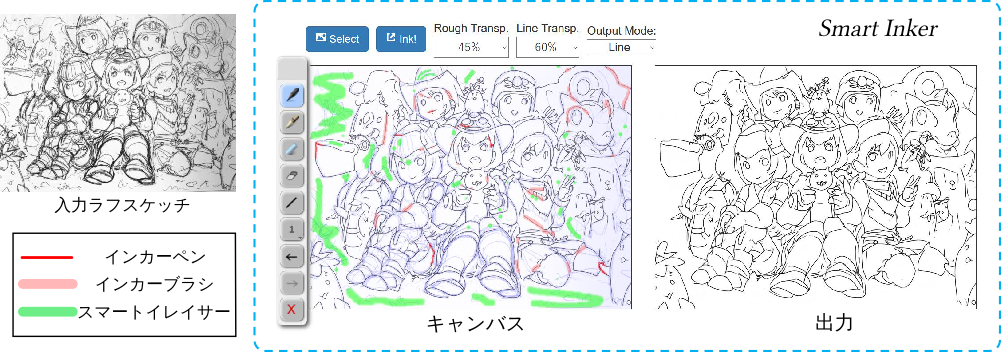

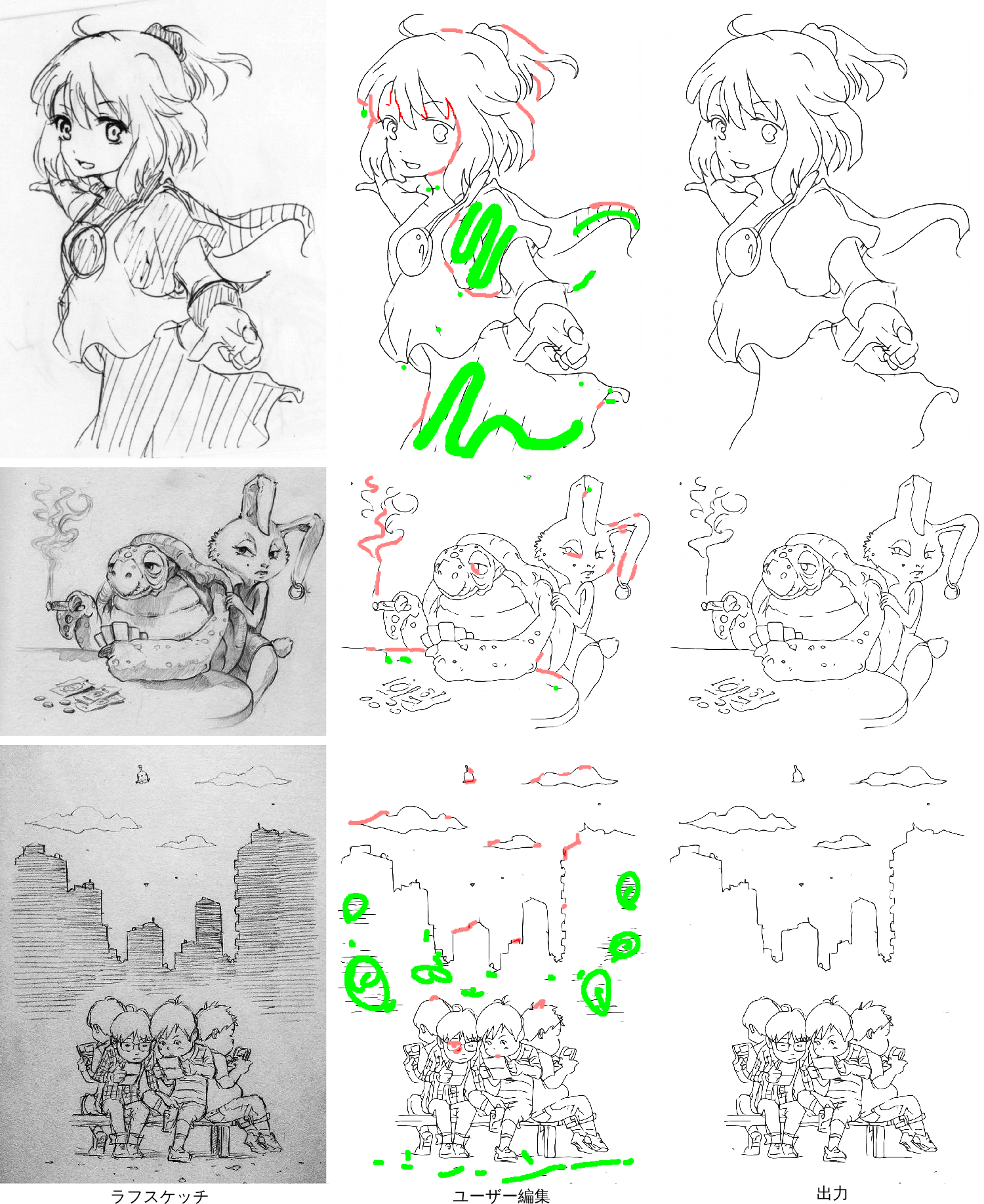

提案手法は全層畳み込みニューラルネットワークにもとづいており、最初にラフスケッチが入力されると自動で線画が出力される。 この線画に対し、以下の3つの編集機能を用いることで、ユーザは線画を自由に効率よく編集することができる:

- インカーペン: 出力線を細かく制御

- インカーブラシ: 粗い入力で途切れた線をきれいに接続

- スマートイレイサー: 指定された線を消しつつ重要な線を保持

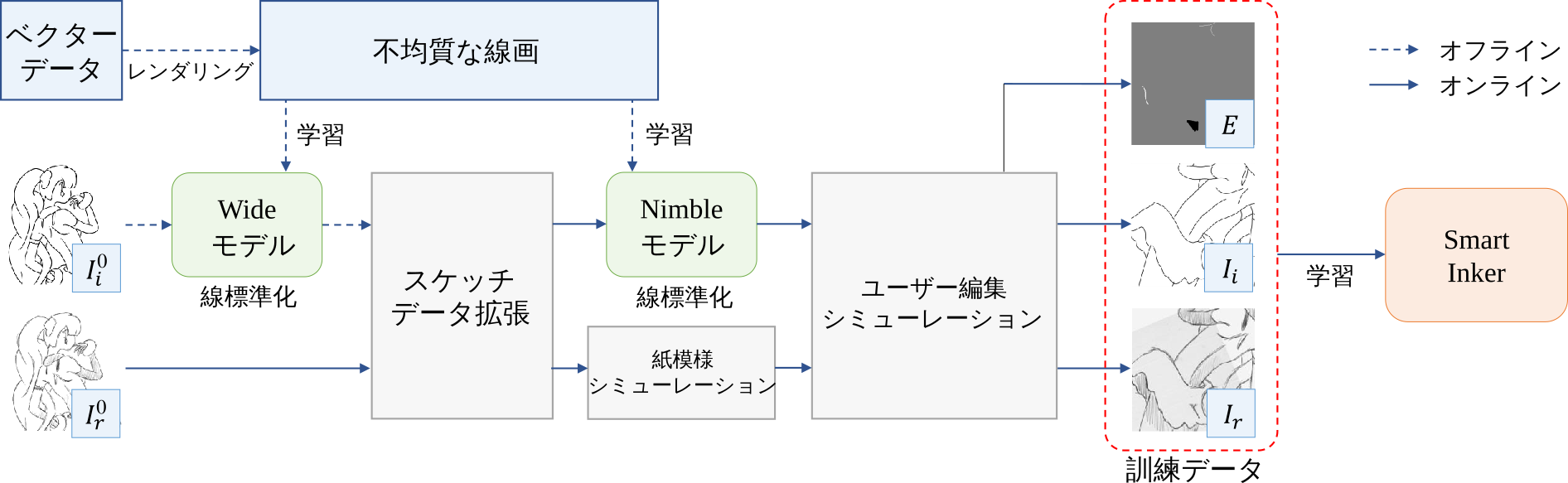

本手法はデータ駆動型であり、それぞれのツールの入力と正解画像を再現するようにユーザ編集をシミュレーションし、 そのユーザ編集とラフスケッチ両方を入力として正解の線画を出力するようにネットワークを学習させることで、この対話的な編集を実現している。

スマートツール

次に、スマートインカーを構成するそれぞれのスマートツールについて詳しく説明する。

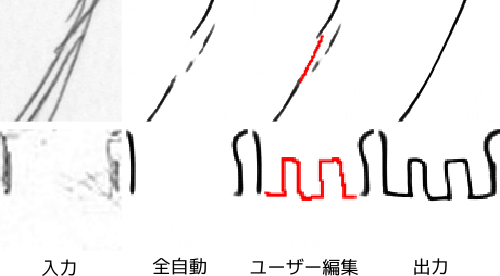

インカーペン

インカーペンは線画を細かく編集するためのツールであり、入力のラフスケッチとユーザー編集両方を考慮して線を出力することが、一般的なペンツールとの主な違いになっている。 このツールでは、ユーザー編集が完璧でなくても途切れた線を自然につなげることが可能である。

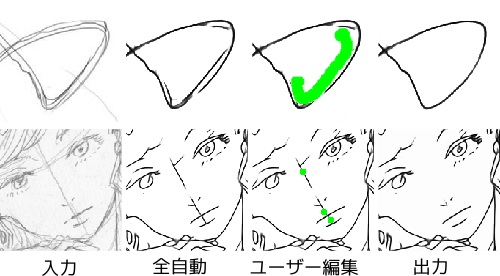

インカーブラシ

インカーブラシは、線が途切れている箇所をブラシストロークで指定するだけで、ラフスケッチに合ったきれいな線を生成してくれるツールである。 インカーペンと違い細かい線の編集には向いていないが、大雑把な編集のみで線画を編集できるため、インカーペンよりも使用が推奨されるツールである。

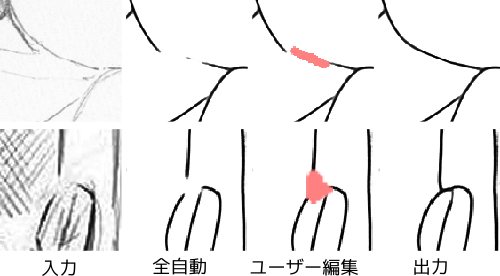

スマートイレイサー

スマートイレイサーは一般的な消しゴムツールに似ているが、ラフスケッチとユーザー編集両方に反応し、指定された線を消しつつ重要な線は保持する特徴がある。

モデル

スマートインカーはencoder-decoder型の畳み込みニューラルネットワークであり、ラフスケッチと線画のペアおよびシミュレートされたユーザ入力を用いて学習される。 線画化の精度を向上させるため、まず最初に訓練データに入っている正解線画を“細線化ネットワーク”に通し、線の太さを標準化する。これにより、線の太さにばらつきがある 正解線画を均一な太さの線画に変換でき、より一貫した線画変換を学習させることが可能となる。これにより、複雑なロス関数や後処理なしにネットワークが直接精細な線画を 出力することが可能となる。 次に、実際に編集作業を行うイラストに近いデータをシミュレートするため、単にユーザ編集のみをシミュレートするだけではなく、訓練データにも変更を加える。 すなわち、ラフスケッチに消すべき線を追加したり、つなぐべき線の一部を消去したりすることで、より実際の使用場面に則した訓練データを生成している。

結果

提案手法を用いて紙からスキャンされた複雑なラフスケッチにペン入れした結果。2列目の入力ラフスケッチはDavid Revoy氏(www.davidrevoy.com)の作品でCC-by 4.0の下、3列目の入力画像は窪之内英策氏(@EISAKUSAKU)のイラストで非商用・研究目的のみで使用している。

論文の詳細は論文を参照してください。

本研究は一部JST CREST (No. JPMJCR14D1)、JST ACT-I (No. JPMJPR16UD, No. JPMJPR16U3) の援助を受けている。